Etika AI: praktické úvahy (nejen) v energetice

Umělá inteligence (dále jen AI) postupně a stále rychleji proniká do všech sfér lidské existence a činnosti. Někteří autoři ji proto přirovnávají k objevu a využívání elektřiny, jiní o ní hovoří jako o obrovské vlně, která se brzy převalí celou lidskou společností.

ABSTRACT: Artificial intelligence is increasingly penetrating all spheres of human existence and activity. The implications of the rapidly growing deployment of AI can be extremely positive, but there are also significant risks associated with the use of AI, which is why the ethics of AI have also come to the fore in the past few years.

Důsledky pokroků na poli AI a prudce rostoucího nasazování AI v jejích rozličných podobách mohou být mimořádně pozitivní: dříve zcela nevídaný vědeckotechnický pokrok, generování blahobytu a zvýšení kvality i délky lidského života. S využíváním AI jsou však spojena i nemalá rizika.

S postupujícím rozvojem AI se v posledních několika letech dostala do popředí také etika tohoto oboru. Jedná se o mladou subdisciplínu aplikované etiky, která se nesnaží nějaký fenomén jen popisovat, ale především nabídnout praktická normativní (závazná) vodítka. Jejich respektování by mělo přispět k tomu, aby systémy AI a jejich využívání respektovaly základní lidské hodnoty, práva a etické principy, jinými slovy, že využívání AI lidmi (a rozhodování AI) bude pro dobro všech.

AI hraje v lidské společnosti stále významnější roli a tento trend bude prudce narůstat. S její rostoucí důležitostí (a schopností pozitivně i negativně ovlivňovat stále více aspektů lidské existence) roste i uvědomění, že AI je třeba pečlivě sledovat a regulovat. Mnohé společnosti již nějakou formu AI využívají, jiné se k tomu chystají. Všechny zodpovědné společnosti si však velmi dobře uvědomují, že zavádění či využívání AI není pouze (a ani v první řadě) technický problém. V přípravě je také nařízení Evropského parlamentu a Rady, kterým se stanoví harmonizovaná pravidla pro umělou inteligenci tzv. AI Act. Etika AI a s ní spojený problém regulace již dávno není teoretickou otázkou, jíž se zabývají pouze profesionální etici.

ETICKÉ KODEXY A REGULACE AI

Mnohé významné společnosti (zvláště v zahraničí) již ustanovily mezioborové etické komise či poradní orgány složené z etiků, právníků, informatiků a dalších profesí. Jejich úkolů je celá řada: vytvářet etické kodexy pro využívání AI, etická desatera, podrobné postupy pro implementaci etických kodexů, pravidelné sledování systémů AI a jejich vyhodnocování ve světle závazných etických principů a norem, které vyjadřují respekt k lidským právům a hodnotám.

Etika je známá tím, že v ní existuje více proudů a určitá názorová neshoda. Chceme-li ale AI skutečně regulovat, musíme najít nějaký základní konsensus na tom, o jaké principy by se tato regulace měla opírat. Může se to zdát jako nelehký úkol (a nelehký úkol to skutečně je), naštěstí lze říci, že se v různých národních a mezinárodních dokumentech vcelku jednoznačnou shodu najít podařilo.

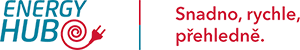

Etické kodexy regulující využívání AI a s nimi spojené nastavování firemních politik, vnitřních předpisů a směrnic, mohou stavět na třech důležitých pilířích (viz obrázek 1).

Obrázek č. 1: Základní pilíře etiky umělé inteligence

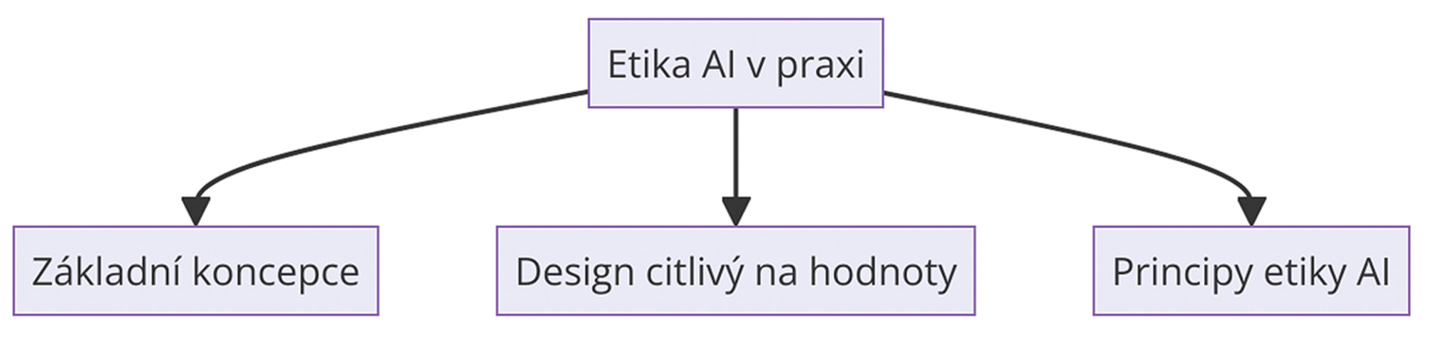

Zvláště v našem evropském kontextu bychom měli vycházet z dokumentu Evropské komise s názvem Ethics Guidelines for Trustworthy AI, který zavádí pojem „důvěryhodné umělé inteligence“. I když byl tento pojem někdy kritizován, základní idea je jasná: systémy AI by měly splňovat určitá kritéria, abychom jim mohli důvěřovat. Tato kritéria spadají do tří hlavních kategorií: první se týká platného práva, druhá etických principů a konečně třetí technických požadavků (viz obrázek 2).

Obrázek č. 2: Kritéria důvěryhodné umělé inteligence

Žádný z těchto požadavků není triviální. Respekt k platnému právu nezajistí žádná jednoduchá algoritmická procedura. Právní normy se aplikují na reálný a často velmi komplexní svět lidské společnosti a jejich aplikace vyžaduje znalost kontextu a umění interpretace celé řady faktorů. Totéž platí i pro etické principy. Ty se navíc často dostávají do sporu a je třeba je vyvažovat; žádná obecná a snadno aplikovatelná procedura vyvažování těchto principů neexistuje. Technická robustnost zahrnuje celou řadu (v případě AI často) náročných požadavků, např. transparentnost, vysvětlitelnost, bezpečnost a spolehlivost. Už z toho je zjevné, že praktická regulace AI není jednoduchá záležitost a je třeba ji svěřit skupině vyškolených odborníků.

DESIGN CITLIVÝ NA HODNOTY

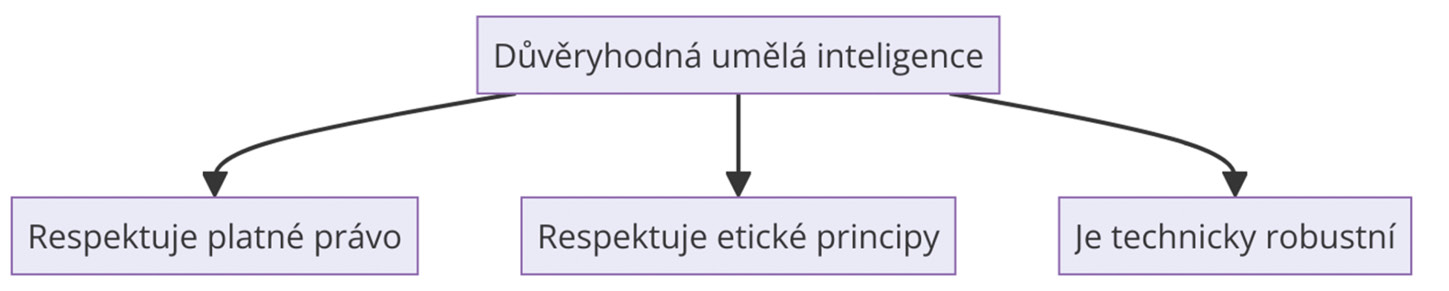

Přístup označovaný jako design citlivý na hodnoty lze chápat jako jakousi obecnou metodologii zavádění (nejen) AI a její kontinuální kontroly. Jedná se o proces tvořený 4 fázemi, které na sebe navazují (viz obrázek 3).

Obrázek č. 3: Procesy designu citlivého na hodnoty

Prvotní analýza před zavedením AI do provozu se soustřeďuje na to, jaké hodnoty AI posílí, jaké benefity přinese lidem a společnosti, ale také na možná rizika, hledání nezamýšlených důsledků a budování mechanismů eliminace či alespoň zmírňování těchto rizik a špatných důsledků. Všechny tyto úvahy musí být promítnuty do návrhu systému AI, je tedy třeba již na začátku myslet na to, aby byl navržený takovým způsobem, aby například nediskriminoval, neprolamoval se do lidského soukromí, chránil osobní údaje a nepůsobil újmu. Následným krokem je implementace hodnot a mechanismů eliminace a zmírňování rizik a újmy, na nějž navazuje samotné využívání AI a její údržba. Design citlivý na hodnoty však představuje metodologický přístup k regulaci AI, který je kontinuální: využívání AI je třeba neustále sledovat, zjišťovat, jaké dopady má na lidskou společnost, jak efektivní jsou mechanismy eliminace a zmírňování rizik, zda se neobjevily důsledky, které nikdo nepředvídal. Tato analýza se musí promítnout do úprav návrhu systémů AI a implementace a následně opět navazuje na fázi využívání.

ZÁKLADNÍ ETICKÉ PRINCIPY AI

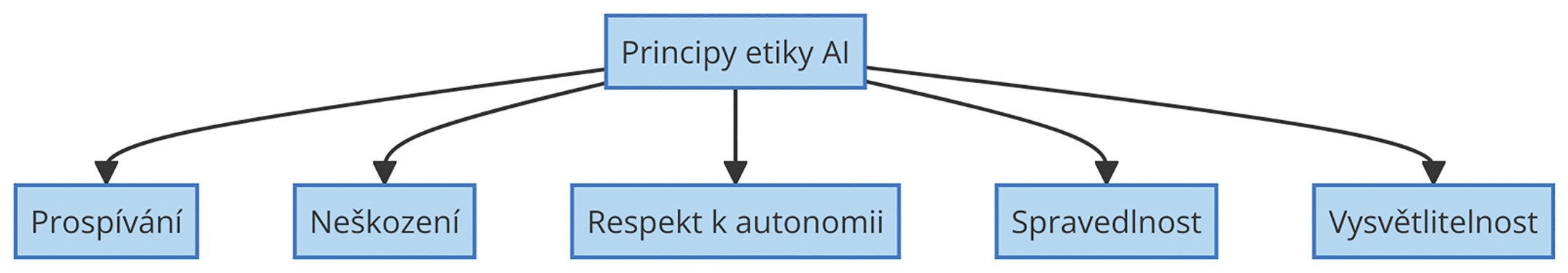

První dva pilíře, z nichž může vycházet tvorba prakticky orientovaných firemních kodexů etiky AI, jsou kompletní. Zbývá pilíř poslední a neméně důležitý, identifikace základních etických principů. Většina relevantních dokumentů se shoduje na pěti etických principech (viz obrázek 4).

Obrázek č. 4: Základní principy etiky umělé inteligence

Tyto principy jsou obecné a považují se za stejně důležité, neexistuje tedy mezi nimi žádná hierarchie. První princip požaduje, aby systémy AI prospívaly lidem, společnosti a životnímu prostředí, druhý zapovídá působení újmy, třetí vyjadřuje požadavek, aby AI respektovala lidskou autonomii a neomezovala možnosti autonomních voleb a jednání, čtvrtý v zásadě ukládá povinnost respektovat lidskou rovnost a zákaz diskriminace a konečně poslední, považovaný za specifický princip etiky AI, klade na AI obtížně splnitelný požadavek, aby její rozhodnutí byla pochopitelná a vysvětlitelná.

Všechny tři pilíře (viz obrázek 1) jsou konceptuálním, metodologickým a normativním rámcem pro vytváření kodexů etiky AI a regulaci systémů AI. Nelze si však nevšimnout, že etické principy jsou velmi obecné a jejich praktická aplikovatelnost v konkrétních kontextech využívání systémů AI může být velmi obtížná. Je proto velmi důležité soustředit se také na povahu AI a kontext jejího využití.

ETIKA AI V ENERGETICE

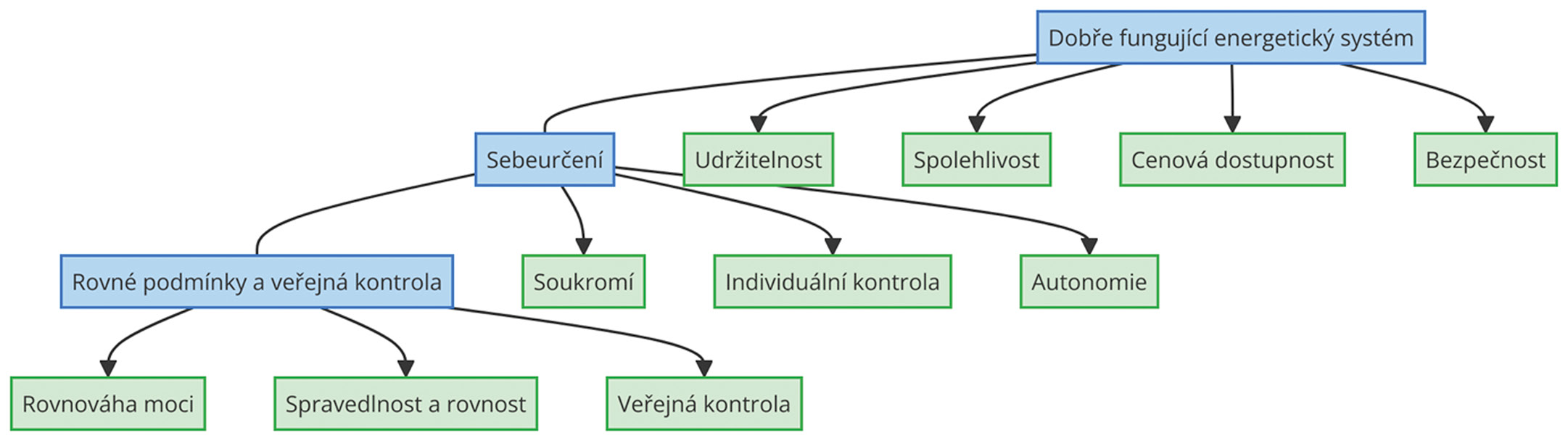

Společnost ČEPS, výhradní provozovatel přenosové soustavy ČR, si u Ústavu informatiky objednala úvodní studii, která měla představit současný stav diskuse na poli etiky AI se zvláštním přihlédnutím k energetice. Studie poslouží jako východisko k vytváření specifičtěji zaměřených dokumentů, nastavení vnitřní politiky společnosti, tvorbě firemních předpisů a směrnic. Současně je důležitým dokladem nutnosti bližšího určení kontextu využívání AI a podrobnější identifikace důležitých hodnot (můžeme jim říkat doménově-specifické hodnoty), jimiž se chce při využívání AI řídit. Tyto hodnoty lze zařadit do tří kategorií a v rámci každé z nich identifikovat konkrétnější instance (viz obrázek 5).

Obrázek č. 5: Doménově-specifické hodnoty pro nasazení AI v energetice

Identifikace těchto hodnot je důležitá sama o sobě, protože ukazuje, co je pro danou společnost důležité a jaké hodnoty chce respektovat a posilovat. Kromě toho a neméně podstatné je to, že poskytuje praktický návod, jak v rámci procesu popsaného jako design citlivý na hodnoty analyzovat a sledovat dopady AI ve světle etických principů. Umožňuje přesněji určit možné formy újmy a škod, identifikovat typy rizik a efektivně vytvářet mechanismy jejich eliminace a zmírňování. Vezměme si například hodnotu soukromí, s níž je spojena ochrana osobních dat. Identifikace této hodnoty umožňuje celou řadu analýz a postupů. Před zavedením AI je například důležité zvažovat, na jakých datech bude trénovaná, jak je zajištěna anonymizace dat, jaká data se budou sbírat a proč, jak se budou ukládat, zpracovávat, jak budou zabezpečená. Dále je možné vytvořit pozici datového manažera, který bude dohlížet na práci s daty ve všech fázích (sběr, ukládání, zpracovávání, vytváření modelů, aplikace modelů) a vytvářet mechanismy efektivní ochrany soukromí. A samozřejmě bude kontinuálně sledovat využívání AI a navrhovat způsoby, jak zajistit respekt ke všem platným právním normám a etickým principům v oblasti ochrany soukromí a osobních dat.

Vypracování obecné studie o současném stavu diskuse v oblasti etiky AI je prvním krokem. Vyplývá z ní doporučení, že společnost, která se zabývá nasazováním AI, by se měla zabývat i tvorbou etického kodexu, který již bude specificky zaměřený na potřeby společnosti, způsoby využívání AI a jejich konkrétní kontexty. Jedná se však o krok velmi důležitý a symbolický, jenž ukazuje, že společnost bere velmi vážně výzvy spojené s využíváním AI a chce být ve své sféře činnosti skutečným leaderem.

O AUTORECH

PhDr. David Černý, Ph.D., působí v Oddělení umělé inteligence Ústavu informatiky AV ČR a na Ústavu státu a práva AV ČR. Věnuje se aplikované etice (medicína, AI) a filosofii AI. Mezi jeho nejnovější publikace patří např. The Principle of Double Effect. A History and Philosophical Defence (New York: Routledge, 2020, 2022) či Autonomous Vehicle Ethics: The Trolley Problem and Beyond (New York: Oxford University Press, 2023; společně s R. Jenkins a T. Hříbek).

Ing. Vít Šumpela pracuje v ČEPS, a.s., v oddělení Digitální transformace a má mimo jiné na starosti podporu rozvoje AI ve společnosti. V minulosti působil na různých pozicích ve veřejné správě (Ministerstvo průmyslu a obchodu, Zlínský kraj, Ministerstvo pro místní rozvoj), kde rozvíjel projekty digitální transformace.

Kontakt: david.cerny@ilaw.cas.cz, sumpela@ceps.cz

Tomáš Brejcha

Související články

Nejdřív plné sklady, pak rychlý pád cen. Obchodníci s fotovoltaikou řeší, jak ustát turbulence na solárním trhu

Solární boom na střechách rodinných domů skončil a s ním skončí i desítky instalačních firem, většinou těch, které se do tohoto by…

Evropští oceláři v krizi. Buď s pomocí vlád dekarbonizujeme, nebo zavřeme, říká šéf asociace

Evropské ocelářství čelí největší krizi za poslední dekádu. Od roku 2018 poklesla produkce oceli v EU o 20 procent. Důvodem je pře…

Čo je nové s DeepSeek: Vývoj zrejme nestál pár miliónov, četbot má vážne bezpečnostné riziká

Viac ako týždeň po tom, čo sa četbot čínskeho startupu DeepSeek stal najpopulárnejšou aplikáciou v USA a rozkýval akciové trhy, sa…

Clá by ohrozili obchod s kovmi

Kanada vyváža do USA obrovské množstvá nerastných surovín.

Evropské zásoby plynu rychle mizí. Během léta se doplňování prodraží

Objem plynu v evropských zásobnících splňuje na počátku února jen těsně cíle, které stanovila Evropská komise. I proto řada odborn…

Kalendář akcí

Očekávaný vývoj odvětví energetiky v ČR a ve světě – 20. ročník

AMPER 2025

Hydrogen days 2025

24. energetický kongres ČR

ENERGY-HUB je moderní nezávislá platforma pro průběžné sdílení zpravodajství a analytických článků z energetického sektoru. V rámci našeho portfolia nabízíme monitoring českého, slovenského i zahraničního tisku.